发布时间:北京时间 2026年4月10日 | 本文全长约3500字,阅读约10分钟

在校园表白墙这个充满青春气息的场景里,每天涌动着成千上万条私信——有人忐忑地询问“怎么表白成功率更高”,有人深夜倾诉心事,有人想查往期话题。面对海量消息,人工回复显然不现实。于是,越来越多校园运营者开始引入表白墙AI助手,它不仅能7×24小时在线解答问题,还能在情感支持、信息查询等场景中扮演“虚拟搭档”的角色。许多初学者的认知还停留在“配置一个关键词回复脚本”的阶段——换句话问就答不上来,更别提记住上下文了。本文将带你从零开始,逐步拆解表白墙AI助手背后的技术原理,覆盖大模型(LLM)、检索增强生成(RAG)、Agent架构等核心知识点,并提供可运行的代码示例与高频面试考点,帮你构建完整知识链路。

一、痛点切入:传统关键词匹配为什么不行

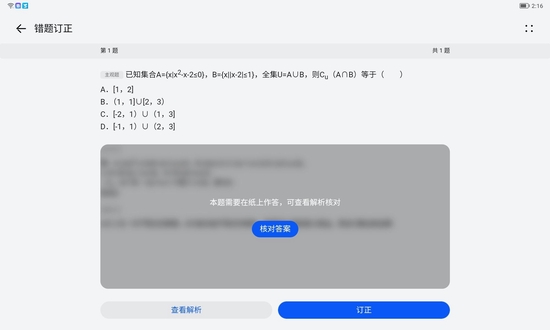

先看一个最简单的实现——用Python写一个关键词回复脚本:

传统关键词匹配脚本 def reply(message): if "表白" in message: return "勇敢去表白吧!" elif "怎么追" in message: return "真诚最重要~" else: return "我不太明白你的意思哦"

这个方案的问题很明显:

语义理解差:用户问“我有喜欢的人但不敢说”,包含“喜欢”但不含“表白”,脚本直接命中else分支

无上下文记忆:用户先问“怎么追人”,再追问“她喜欢看书,怎么办”,脚本完全无法关联

可扩展性差:每增加一个意图就要硬编码一条规则,维护成本高

无法处理复杂场景:查往期表白墙内容、情感计算、个性化建议等需求无从满足

这正是大模型技术切入的核心场景——让AI真正“理解”用户在说什么,而不是机械匹配关键词。

二、核心概念讲解:大语言模型(LLM)

大语言模型(Large Language Model,LLM)是基于Transformer架构、通过海量文本数据预训练得到的生成式AI模型。简单来说,它就像一个读完了整个互联网的“超级学霸”——当你向它提问时,它会根据训练学到的语言规律,逐词生成最合理的回复。

生活化类比:LLM就像一个参加过大胃王比赛的厨师——他品尝过成千上万道菜(海量训练数据),虽然没吃过你刚点的外卖,但能根据过往经验判断“这个搭配大概率好吃”。这就是大模型的泛化能力:它不需要见过一模一样的问法,也能理解相似语义。

核心价值:LLM解决了传统规则系统“无法理解未见过表达”的根本性难题。应用于表白墙AI助手,用户即使说“那个……我有点心动”“怎么暗示ta”,模型也能准确识别出“情感咨询”意图,并给出有温度的回答。

三、关联概念讲解:RAG(检索增强生成)

RAG(Retrieval-Augmented Generation,检索增强生成)是一种让大模型在回答前先“翻资料”的技术方案-45。

标准定义:RAG的核心思路是——用户提问时,先从外部知识库中检索相关文档片段,再将检索结果连同问题一起交给大模型,让模型基于这些资料生成答案。

它与LLM的关系:LLM是“大脑”,RAG是“查资料的引擎”。LLM的知识截止于训练时刻,无法回答“昨天的表白墙投稿内容”;RAG通过实时检索,把最新信息喂给LLM,让答案“有据可依”。

工作原理三步走:

文档向量化:将知识库(如历史投稿记录、FAQ文档)切分成片段,通过嵌入模型(Embedding Model)转换成向量,存入向量数据库(如Milvus、Chroma)

检索:用户提问时,将问题也转换成向量,从数据库中检索最相似的K个片段

生成:将检索结果与用户问题拼接成提示词(Prompt),交给大模型生成答案

应用场景:在表白墙AI助手中,RAG可以让模型回答“上周最火的投稿是什么”“有没有人问过怎么送礼物”等需要检索历史数据的问题,避免“我不知道”的尴尬。

四、概念关系与区别总结

| 概念 | 角色定位 | 核心能力 | 在AI助手中的作用 |

|---|---|---|---|

| LLM | 核心引擎(大脑) | 语言理解与生成 | 理解用户意图、生成回复 |

| RAG | 知识增强(外挂资料库) | 实时检索外部信息 | 让模型回答最新/私有知识 |

| Agent | 自主决策者(指挥官) | 规划、记忆、调用工具 | 完成多步骤任务(如下单、查票) |

一句话总结:LLM是大脑,RAG是字典,Agent是手脚——三者结合才能打造真正智能的AI助手。

Agent的引入让表白墙AI助手从“问答机器人”升级为“任务执行者”——例如用户说“帮我查一下上周所有关于表白的投稿”,Agent会自主规划:先调RAG检索知识库→再调统计分析工具→最后生成汇总报告-45。

五、代码示例:用Dify + Gewechat搭建表白墙AI助手

下面展示一个完整的工程化实现——基于Dify平台(LLMOps工具)和Gewechat框架(微信协议适配层),将大模型能力接入微信生态-32。

5.1 系统架构图(三层解耦)

┌─────────────────────────────────────────────────┐ │ 用户层:微信聊天窗口(私聊/群聊@机器人) │ └─────────────────────────────────────────────────┘ ↓ ┌─────────────────────────────────────────────────┐ │ 协议适配层(Gewechat): │ │ - 模拟微信网页版登录,维持WebSocket长连接 │ │ - 捕获XML/JSON格式原始消息,转换为统一语义结构 │ │ - 以HTTP API形式暴露消息收发能力 │ └─────────────────────────────────────────────────┘ ↓ ┌─────────────────────────────────────────────────┐ │ AI能力调度层(Dify平台): │ │ - 可视化Prompt编排 + 多轮对话上下文管理 │ │ - 知识库RAG增强(上传文档自动切片向量化) │ │ - Function Calling(工具调用)编排 │ └─────────────────────────────────────────────────┘ ↓ ┌─────────────────────────────────────────────────┐ │ 业务集成层(Dify on Wechat容器): │ │ - 轮询Gewechat接口获取新消息 │ │ - 构造Dify API请求,接收流式响应 │ │ - 智能消息路由(区分私聊/群聊/系统通知) │ └─────────────────────────────────────────────────┘

5.2 Docker部署核心步骤

1. 拉取Gewechat镜像 docker pull registry.cn-chengdu.aliyuncs.com/tu1h/wechotd:alpine 2. 启动Gewechat容器(需替换为实际IP) docker run -itd \ -v ~/wechat_data:/data \ -p 2531:2531 -p 2532:2532 \ -e SERVER_IP=192.168.1.100 \ --name=gewechat \ registry.cn-chengdu.aliyuncs.com/tu1h/wechotd:alpine 3. 启动Dify on Wechat容器(轮询消息并调用Dify API) docker run -itd \ -e GEWECHAT_API=http://gewechat:2531 \ -e DIFY_API_KEY=your_api_key_here \ -e DIFY_API_URL=https://api.dify.ai/v1/chat-messages \ --network gewechat-net \ --name=dify-wechat \ dify-on-wechat:latest

关键步骤解释:

设置共享网络(

--network gewechat-net):打通两个容器之间的内网通信,避免使用host网络带来的端口冲突,同时确保API调用延迟控制在毫秒级(实测平均RTT <15ms)-32环境变量注入API Key:杜绝硬编码泄露风险,这是生产部署的基本安全规范

流式响应:Dify支持SSE(Server-Sent Events)流式返回,用户能逐字看到AI生成过程,体验更自然

5.3 Dify工作流配置(可视化无代码)

在Dify Web UI中创建“表白墙助手”应用,核心配置项:

系统提示词(System Prompt)示例:

你是一位温暖贴心的校园表白墙AI助手。你的任务是: 1. 耐心倾听用户的感情困惑,给予积极正向的鼓励 2. 回答关于表白技巧、情感沟通、恋爱心理等方面的问题 3. 如用户需要查询往期投稿,调用RAG知识库检索 4. 回答需简洁、有温度,避免长篇大论 5. 遇到敏感话题(如极端情绪),建议用户联系校内心理辅导老师

知识库绑定:上传FAQ文档、历史投稿记录(TXT/PDF/Word),Dify自动完成切片、向量化并存入内置向量库-32。

六、底层原理支撑

上述代码示例之所以能跑通,底层依赖三大技术支柱:

WebSocket长连接:Gewechat通过WebSocket维持微信登录态,捕获原始消息包。这与HTTP短连接不同——WebSocket允许服务器主动推送消息,无需客户端持续轮询,大大降低延迟和资源消耗。

向量检索技术:RAG的核心是将文本转换为高维空间向量,通过余弦相似度等算法快速找到语义最接近的文档片段。常用的向量数据库有Milvus、Chroma、FAISS等。

Function Calling(函数调用) :大模型不能直接操作外部系统(如查数据库、发邮件)。Function Calling通过标准化协议,让模型“告诉”系统要调用哪个工具、传入什么参数,系统执行后把结果返回给模型-45。例如,用户问“查一下上周五有没有人投稿说感谢室友”,Agent会调用

query_database(date='2026-04-04', keyword='感谢室友')这个函数。

以上知识点将在后续“Agent底层架构”专题中深入展开,欢迎持续关注。

七、高频面试题与参考答案

Q1:大语言模型(LLM)和RAG的关系是什么?为什么单独用LLM不够?

踩分要点:点明RAG解决LLM的知识局限 → 解释原理 → 举例说明

参考答案:LLM的知识截止于训练时刻,无法回答私有数据或实时信息。RAG通过“先检索、后生成”的机制,将外部知识库中的相关内容作为上下文喂给LLM,从而让模型生成有据可依的答案。例如在校园表白墙AI助手中,LLM本身不知道历史投稿内容,但结合RAG检索后就能准确回答“上周最火的表白故事”。

Q2:Agent和传统工作流(Workflow/Chain)的核心区别是什么?

踩分要点:自主性 vs 固定流程 → 决策能力 → 适应性

参考答案:传统工作流(如LangChain的Chain)是预定义的、线性的硬编码流程;而Agent具备自主性——它根据目标自发决定执行路径,通过“推理-行动-观察”(ReAct模式)不断调整策略。例如用户说“帮我查表白墙并生成周报”,Agent会自主规划:先检索→再统计→最后生成报告;而传统工作流需要开发者预先写死每一步,灵活性远低于Agent-63。

Q3:ReAct模式的工作原理是什么?

踩分要点:拆解ReAct全称 → 说明循环机制 → 举例

参考答案:ReAct = Reasoning + Acting。它通过交替执行思考(推理下一步做什么)和行动(调用工具/API)来解决问题,每次行动后都会观察结果,再进入下一轮思考。例如用户问“最近表白墙的热门话题有哪些”,Agent的ReAct循环是:Thought(我需要检索历史投稿)→ Action(调用RAG检索)→ Observation(返回5条记录)→ Thought(需要统计分析)→ Action(调用统计工具)→ Observation(话题分布)→ 最终生成回答。

Q4:在RAG系统中,如何提高检索的准确率?

踩分要点:分片策略 → 检索优化 → 排序策略

参考答案:主要从三个方面优化:(1) 分片策略:文档不能切太碎(上下文割裂),也不能切太整(检索不精准),技术手册按章节切,问答对按条目切;(2) 检索优化:采用两阶段检索——先用向量召回一批候选片段,再用重排模型(Reranker)精排,后者能更细粒度判断相关性;(3) 意图预判:在检索前加一层意图识别,区分“怎么配”和“配错了怎么办”这类不同指向的查询-45。

Q5:多轮对话中如何处理上下文溢出问题?

踩分要点:上下文压缩 → 滑动窗口 → 任务拆分

参考答案:常用方案包括:(1) 上下文压缩:将早期对话压缩成摘要,只保留关键信息;(2) 滑动窗口:只保留最近N轮对话;(3) 任务拆分:将长任务拆成多个子任务,每个子任务独立对话,中间结果写入数据库,需要时再读取;(4) 使用支持长窗口的模型作为兜底方案,但优先用工程手段控制token消耗-66。

八、结尾总结

本文围绕表白墙AI助手的构建,完整梳理了从传统规则脚本到智能Agent的技术演进路径:

✅ 核心概念:LLM(大脑)+ RAG(字典)+ Agent(手脚),三者分工明确、协同作战

✅ 代码示例:基于Dify + Gewechat的三层解耦架构,实现了可部署的微信机器人

✅ 底层原理:WebSocket长连接、向量检索、Function Calling是三大技术支柱

✅ 面试考点:覆盖LLM vs RAG、Agent vs Workflow、ReAct模式、RAG优化、上下文管理五大高频问题

一句话复习:从“关键词匹配”到“智能Agent”,本质是从“机械应答”到“理解与决策”的跨越——RAG解决知识不足,Agent解决能力不足,两者叠加才能真正释放大模型的潜力。

预告:下一篇我们将深入Agent底层架构——ReAct模式源码解析、Plan-and-Execute与ReAct的选型对比、以及LangGraph中的节点与边设计,欢迎持续关注。

📌 写在最后:本文所有代码示例已适配2026年最新技术栈,部署时请以官方文档为准。如有疑问或想看特定专题的深度拆解,欢迎在评论区留言交流~

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司