2026年4月9日发布

提到“AI助手”,你的第一反应可能是手机上那个“听得懂人话”的应用。但如果把AI助手戴在手腕上——一块手表秒变“数字伙伴”,不仅能听懂你的语音指令,还能主动预判需求、实时监测健康、跨设备协同工作,这就是我们今天要讲的核心话题:手表AI助手(Watch AI Assistant) 。作为智能穿戴领域的技术高地,手表AI助手正在从“语音遥控器”进化为真正意义上的“腕上智能体”。本文将从概念定义、核心技术、主流产品、底层原理到面试要点,帮你建立完整的技术认知链路。

一、什么是手表AI助手?——从定义到核心能力

标准定义

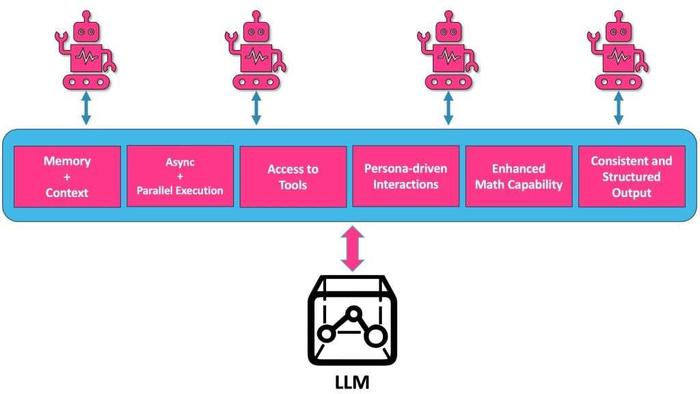

手表AI助手(Watch AI Assistant) ,是指在智能手表等腕戴设备上运行的、具备自然语言交互、情境感知与主动服务能力的AI代理系统。其核心是将大语言模型(Large Language Model, LLM)、端侧AI推理、多模态传感器融合等技术集成到体积小巧、电量受限的穿戴设备中,实现“解放双手、随时随地的智能服务”。

技术构成三要素

一套完整的手表AI助手系统,通常包含三个核心模块:

语音交互层:负责语音唤醒、语音识别(Automatic Speech Recognition, ASR)与语义理解。例如,上海海思结合AI语音识别和多维降噪算法,即便在路边、体育馆等嘈杂环境下,手表也能精准识别语音指令-12。

端侧推理引擎:在手表本地运行轻量化AI模型,处理实时性要求高的任务。高通最新发布的Snapdragon Wear Elite平台内置Hexagon NPU,可在手表本地运行高达20亿参数的AI模型,功耗显著降低-1。

云端协同模块:负责将复杂任务(如长文本生成、多轮对话)卸载到云端大模型,形成“端云协同”架构。华为WATCH 5的“腕上小艺”同时融合盘古大模型和DeepSeek大模型,本地AI保障核心功能的实时性与隐私性,云端智能则按需调用--。

二、痛点切入:为什么需要手表AI助手?

传统交互方式的局限

传统的智能手表交互,依赖触屏点按 + 基础语音命令。以“设置一个明天上午9点的会议提醒”为例:

旧方式:抬起手腕 → 滑动解锁 → 打开日历 → 点击“+” → 滚动选择日期 → 滚动选择时间 → 输入事件名称 → 点击保存

仅这一项操作就需要近10步。

三大核心痛点

交互路径过长:屏幕小、手指粗,在跑步或运动场景下触控操作极其不便。

语音能力薄弱:传统手表语音助手只能执行单轮、预定义指令(如“打电话给张三”),无法处理复杂语义或多轮对话。

被动响应、缺乏主动性:手表只是“工具”,无法主动洞察用户需求——比如检测到心率飙升却不会自动推荐放松方案。

手表AI助手的价值定位

这正是手表AI助手要解决的根本问题:从“用户操作手表”转变为“手表服务用户” 。搭载AI助手的手表,一句话就能完成上述会议设置;更进一步的主动式AI,甚至能在你心率异常时自动提醒、在识别到常规跑步路线时自动播报配速而非“每公里都报一遍”-。

三、核心技术解析(概念A):端侧AI + 端云协同

概念定义

端侧AI(On-Device AI) 是指在手表本地完成AI模型推理的技术路线,无需将数据上传云端。端云协同(Cloud-Edge Collaboration) 则是指本地与云端AI能力的分工配合——简单、实时、隐私敏感的任务由端侧AI处理,复杂、计算密集的任务由云端大模型完成。

为什么端侧AI是关键?

智能手表面临三大“先天不足”:

功耗受限:电池容量通常仅200~500mAh

算力受限:无法运行云端那种百亿级参数的大模型

隐私敏感:健康数据(心率、血氧、睡眠轨迹)是用户最不愿上传的敏感信息

高通在2026年MWC上发布的Snapdragon Wear Elite平台给出了有力回应:这款3nm工艺的穿戴SoC内置Hexagon NPU,提供高达12 TOPS的AI算力,支持运行10亿到20亿参数的端侧模型,同时将续航提升30%-2。更关键的是,它让手表“跑AI任务不依赖云端”,彻底解放了手表作为独立计算设备的潜力-2。

生活化类比

把端云协同想象成“随身笔记本 + 云端图书馆”:

端侧AI是口袋里的便签本,随时记录、快速查阅;

云端大模型是图书馆,查阅复杂资料时才需要跑一趟。

你的私密健康笔记只存在便签本里,绝不外借;需要深度研究报告时才去图书馆。

四、落地实现(概念B):轻量化模型 + 专用NPU

概念定义

轻量化AI模型(Lightweight AI Model) 是指经过压缩、剪枝、量化等技术处理后,参数量大幅降低但仍保留核心能力的AI模型。典型的端侧语音模型如Whisper-Tiny.en仅39M参数,却能在手表上实现实时语音识别-。

NPU(Neural Processing Unit,神经网络处理单元) 则是专门为AI计算设计的硬件加速器,与通用CPU/GPU不同,NPU对矩阵乘法、卷积等AI核心运算做了架构级优化。

与端侧AI的关系

端侧AI(设计理念) → 采用轻量化模型(具体手段) → 在NPU上运行(物理载体)对比:CPU/GPU vs NPU

| 对比维度 | CPU | GPU | NPU |

|---|---|---|---|

| 设计定位 | 通用计算 | 并行图形计算 | AI专用加速 |

| AI推理效率 | 一般 | 较好 | 极致 |

| 功耗 | 较高 | 高 | 极低 |

| 典型用途 | 系统调度 | 渲染/图像处理 | 语音唤醒/图像识别 |

Google Research开源的Coral NPU平台是典型代表——它在仅消耗数毫瓦功率的情况下,达到每秒512 GOPS的性能-11。Coral NPU的设计理念是“从底层硅片开始为AI优化”,不再优先传统标量计算,而是将重点放在机器学习矩阵引擎上-11。

五、概念关系总结:一张图看懂

┌─────────────────────────────────────────────────────────┐ │ 手表AI助手 │ │ ┌─────────────────────────────────────────────────┐ │ │ │ 设计理念:端云协同 │ │ │ │ ┌─────────────┐ ┌─────────────┐ │ │ │ │ │ 端侧AI │ ←→ │ 云端大模型 │ │ │ │ │ │(本地优先) │ │(复杂兜底) │ │ │ │ │ └──────┬──────┘ └─────────────┘ │ │ │ │ │ │ │ │ │ ▼ │ │ │ │ 实现手段:轻量化模型 + NPU │ │ │ └─────────────────────────────────────────────────┘ │ └─────────────────────────────────────────────────────────┘

一句话记忆:端侧AI是“思想上要本地跑”,轻量化模型是“怎么变小”,NPU是“谁来加速”——三位一体,缺一不可。

六、主流生态产品对比

截至2026年4月,三大主流手表AI助手生态格局如下:

| 生态阵营 | 核心AI助手 | 技术路线 | 最新动态 |

|---|---|---|---|

| Gemini | Wear OS端云协同 | 2026年3月31日起Wear OS设备强制切换至Gemini-31 | |

| Apple | Siri(AI升级版) | 本地+云端混合 | watchOS 27将深度融合AI,预计WWDC 2026(6月9日)发布-21 |

| 华为 | 小艺(盘古+DeepSeek) | 双大模型端云协同 | 华为WATCH 5接入双大模型,支持200+项指标智能分析-41- |

生态演进趋势

谷歌于2026年3月31日启动Wear OS向Gemini的强制切换,未手动确认迁移的设备自2026年4月起将无法唤醒语音助手-。苹果watchOS 27则效仿2009年Mac OS X“雪豹”系统的策略,将AI演进与性能优化置于首位-21。华为则通过盘古大模型+DeepSeek双大模型融合,将手表AI能力从“语音助手”升级为“健康智能顾问”-。

从市场数据看,洛图科技预计2025年AI手表渗透率将达到15%,而Canalys预计2027年搭载高级操作系统的智能手表出货量有望达到1亿部,2024-2027年复合增速达14%-50。

七、极简代码示例:端侧语音识别流程

以下代码示意手表端如何完成一次语音指令的端到端处理:

手表端简化伪代码(以轻量化语音模型为例) class WatchAIAssistant: def __init__(self): 加载端侧轻量化模型(如Whisper-Tiny.en,仅39M参数) self.asr_model = load_lightweight_asr() 加载本地意图分类器 self.intent_classifier = load_intent_classifier() 云端API客户端(仅在需要时调用) self.cloud_client = CloudAPIClient() def process_voice(self, audio_input): 1. 端侧语音识别(本地推理,不依赖网络) text = self.asr_model.transcribe(audio_input) 2. 端侧意图识别(隐私敏感任务本地完成) intent, confidence = self.intent_classifier.predict(text) 3. 任务分发:本地可处理的 → 直接执行 if intent in ["set_alarm", "start_timer", "open_app"]: return self._execute_local(intent, text) 4. 复杂任务 → 云端大模型处理 elif confidence < 0.7 or intent in ["complex_chat", "long_generation"]: return self.cloud_client.call_llm(text) 5. 混合模式:本地获取上下文 + 云端增强 else: context = self._get_sensor_context() 心率、位置等 return self.cloud_client.call_llm_with_context(text, context)

关键执行流程:

第10-13行:本地模型完成ASR转录,全程无需网络

第15-17行:意图识别在本地完成,用户隐私数据不离开设备

第19-21行:简单任务(闹钟/计时器)直接在手表OS层面执行

第23-25行:复杂语义理解任务才请求云端大模型

八、底层原理与关键技术栈

手表AI助手的底层能力依赖以下技术栈:

1. 专用AI芯片(NPU)

高通Hexagon NPU支持12 TOPS算力和最高20亿参数的端侧模型,CPU性能提升5倍、GPU性能提升7倍-2。Google Coral NPU则基于RISC-V架构构建,兼容TensorFlow、JAX和PyTorch等主流框架-11。

2. 模型压缩技术

端侧模型的部署需要经过量化(Quantization) ——将32位浮点参数压缩为8位甚至4位整数,模型体积缩小4~8倍,推理速度提升3~5倍,精度损失控制在1%~2%。

3. 安全与隐私保护

端侧AI的天然优势是数据不出设备。Google Coral NPU采用CHERI(Capability Hardware Enhanced RISC Instructions)技术,通过精细化的内存级安全机制构建硬件强制执行的安全沙箱-11。

4. 传感器融合

手表AI助手需整合心率、加速度计、陀螺仪、GPS等十余种传感器数据。Snapdragon Wear Elite支持超过50种传感器接入,为情境感知AI提供数据基础-2。

九、高频面试题与参考答案

面试题1:为什么手表AI要采用端侧AI而不是完全依赖云端?

踩分点:三点递进——延迟、隐私、续航

参考答案:

低延迟:端侧推理消除网络往返时间,语音唤醒响应可控制在100ms以内,云端依赖则可能延迟500ms以上

隐私保护:健康监测数据(心率、血氧、睡眠)属于最敏感的隐私信息,端侧处理确保数据不离开设备

离线可用:手表作为随身设备常处弱网/无网环境(跑步、登山),端侧AI保证基本功能可用

续航优化:频繁云端请求会消耗大量通信功耗,端侧NPU以极低功耗完成推理-2

面试题2:请解释端侧AI、轻量化模型和NPU之间的关系。

踩分点:三者是“理念→手段→载体”的递进关系

参考答案:

端侧AI是设计理念,强调AI能力在设备本地运行,不依赖云端

轻量化模型是实现手段,通过模型压缩(量化、剪枝、蒸馏)将大模型缩小到手表可承载的参数量级

NPU是物理载体,为轻量化模型提供专用硬件加速,实现低功耗、高效率的AI推理

三者关系:端侧AI(Why)→ 轻量化模型(How)→ NPU(What)

面试题3:端云协同在手表AI中如何分工?

踩分点:分场景说明 + 动态路由策略

参考答案:

本地处理:语音唤醒、指令词识别、实时健康监测、简单命令(设闹钟、播报时间)——要求毫秒级响应

云端处理:长文本生成、多轮对话、复杂健康分析报告、联网——计算密集、对实时性要求较低

动态路由:根据任务复杂度、网络状态、电量剩余等因素智能分发

以华为WATCH 5为例:本地NPU与云端盘古大模型通过AI Agent框架协同,本地保障实时性与隐私性,云端开启深度服务-

面试题4:端侧AI如何解决手表功耗与算力的矛盾?

踩分点:四层解决方案

参考答案:

芯片层面:专用NPU比CPU能效比高10~100倍,高通Snapdragon Wear Elite的NPU在极低功耗下完成AI推理-1

模型层面:轻量化模型参数量降至百万级甚至十万级,Google Coral NPU在毫瓦级功耗下达到512 GOPS性能-11

调度层面:大核休眠,NPU常驻,仅在需要时唤醒;异构计算(CPU+GPU+NPU分场景调用)

工艺层面:3nm先进制程降低漏电功耗,Snapdragon Wear Elite基于3nm架构,续航提升30%-2

面试题5:手表AI与手机AI最大的技术差异是什么?

踩分点:物理约束 + 交互场景

参考答案:

| 维度 | 手机AI | 手表AI |

|---|---|---|

| 交互方式 | 触屏为主 + 语音辅助 | 语音为主 + 触屏为辅 |

| 计算资源 | 相对充裕 | 极度受限(电池/体积) |

| 传感器类型 | 通用传感器 | 生物传感器(心率/血氧/ECG)密集 |

| AI主动性 | 被动响应为主 | 主动情境感知(健康预判) |

| 隐私等级 | 高 | 更高(健康数据极其敏感) |

| 核心差异总结 | 语音助手 | 健康管家 + 情境智能体 |

十、结尾总结

全文核心知识点回顾

手表AI助手是运行在腕戴设备上的AI代理系统,核心是端云协同架构

端侧AI解决延迟、隐私、离线三大痛点,是手表AI的基石

轻量化模型 + NPU是实现端侧AI的关键手段和物理载体

三大生态阵营:Google(Gemini)、Apple(AI版Siri)、华为(小艺)正在激烈竞争

底层技术栈:专用NPU、模型压缩、安全沙箱、传感器融合

面试高频考点:端云协同分工、功耗-算力平衡、三概念关系

易错点提醒

⚠️ 不要混淆“端侧AI”和“轻量化模型”——前者是理念,后者是手段

⚠️ 不要认为手表AI等于“手表版手机语音助手”——健康监测和情境感知是其独特价值

⚠️ 面试中注意分点作答,逻辑层次清晰是关键踩分点

下篇预告

下一篇文章我们将深入NPU架构设计,讲解Transformer模型如何在端侧实现高效推理,从算子融合到内存复用,带你理解大模型“塞进”手表背后的工程智慧。

参考资料:

Qualcomm Snapdragon Wear Elite官方发布信息,MWC 2026

Google Research Coral NPU开源平台技术文档,2025

洛图科技/Canalys智能手表市场报告,2025

各厂商WWDC/MWC发布会公开资料

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司